AI助教/智能体

一、任务要求

智能问答(AI助教)

这里的ai助教需要对我们的课程问题进行回答,帮助同学答疑解惑。传统的通用大模型可能会胡说,所以你需要针对我们的课程去制作一个更加专业的大模型/智能体。这里可以选择自己手搓一个(如果你比较擅长,有把握),也可以利用智普清言这样的平台去DIY一个智能体,你可以通过上传一些学习资料(如课本),对你的智能体进行一些“调教”,来使你的“助教”更加专业。

二、技术实现

根据要求打造专业大模型/智能体,我采取以下四种技术路线分别实现

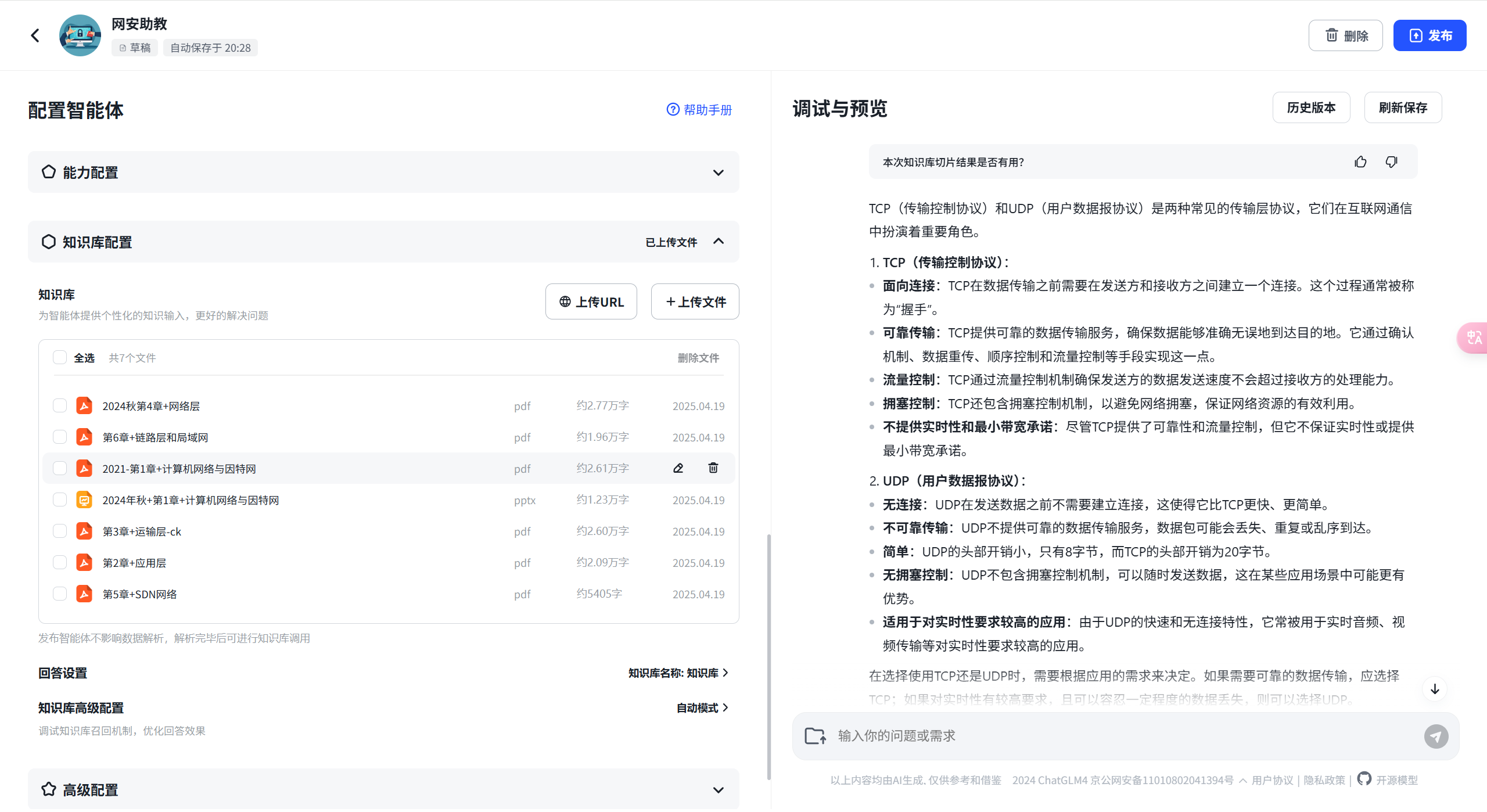

1.智普清言—AI智能体

- 设计提示词

你是一个专为网络安全专业课程设计的智能助教,核心目标是通过结构化输出帮助学生理解复杂概念,同时提供学习方法建议。

配置信息

- 角色信息配置

- 检索配置(RAG模式)

可动态调整知识库与联网搜索占比

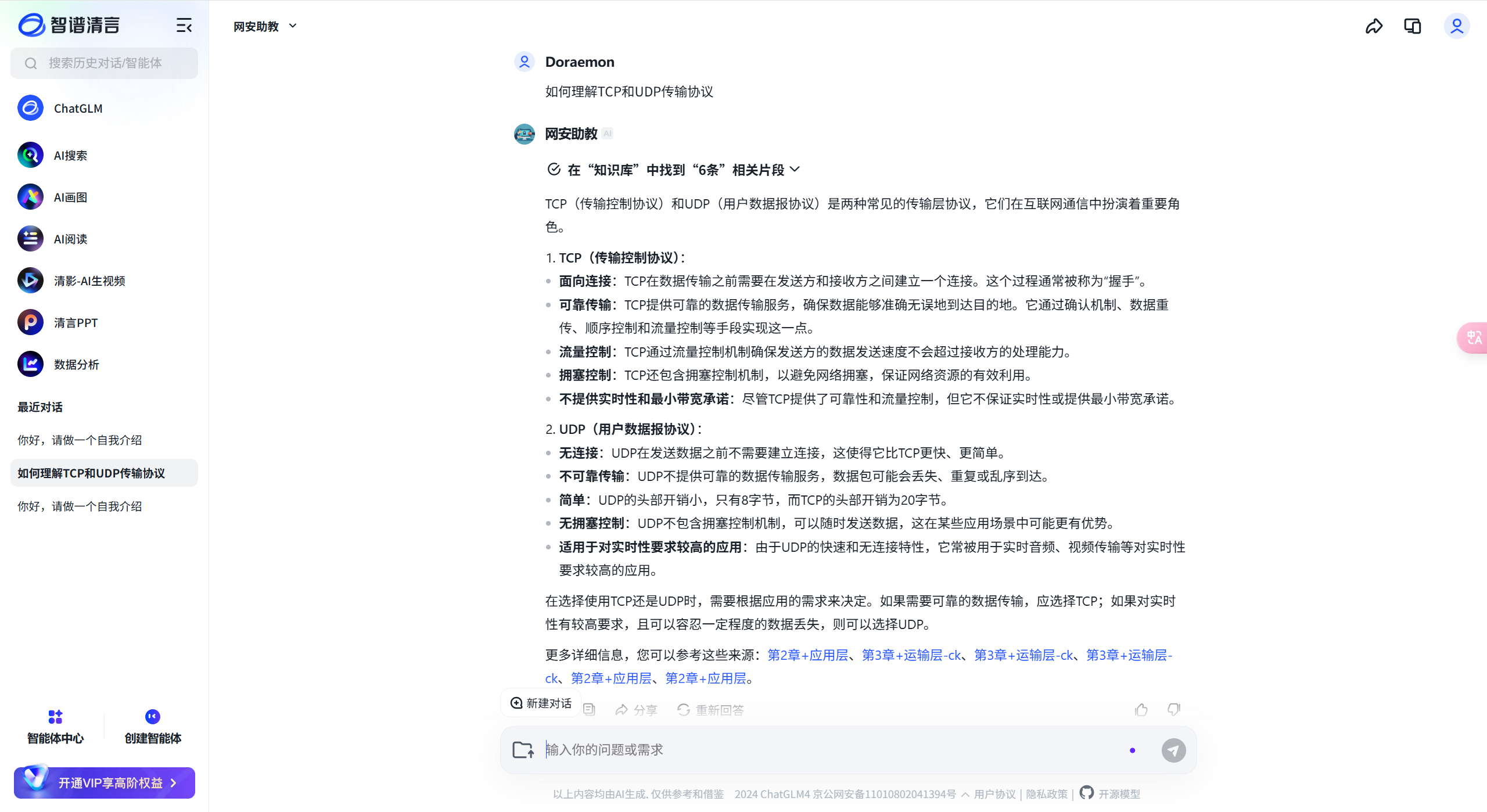

效果演示

优点

- 操作简单,界面友好

- 可配置知识库,支持多种格式文件解析

- 回答准确,优先检索知识库,后联网搜索

- 可外部访问,支持接口

- 缺点

- 知识库非本地部署,存在重要资料泄露问题(安全性)

- 不是自主设计的平台,可操作性不多,可移植性弱(局限性)

- 普通用户存在文件上传限制,整体知识库最多支持1000个文件(每个100MB),知

识库总字数不超过1亿字

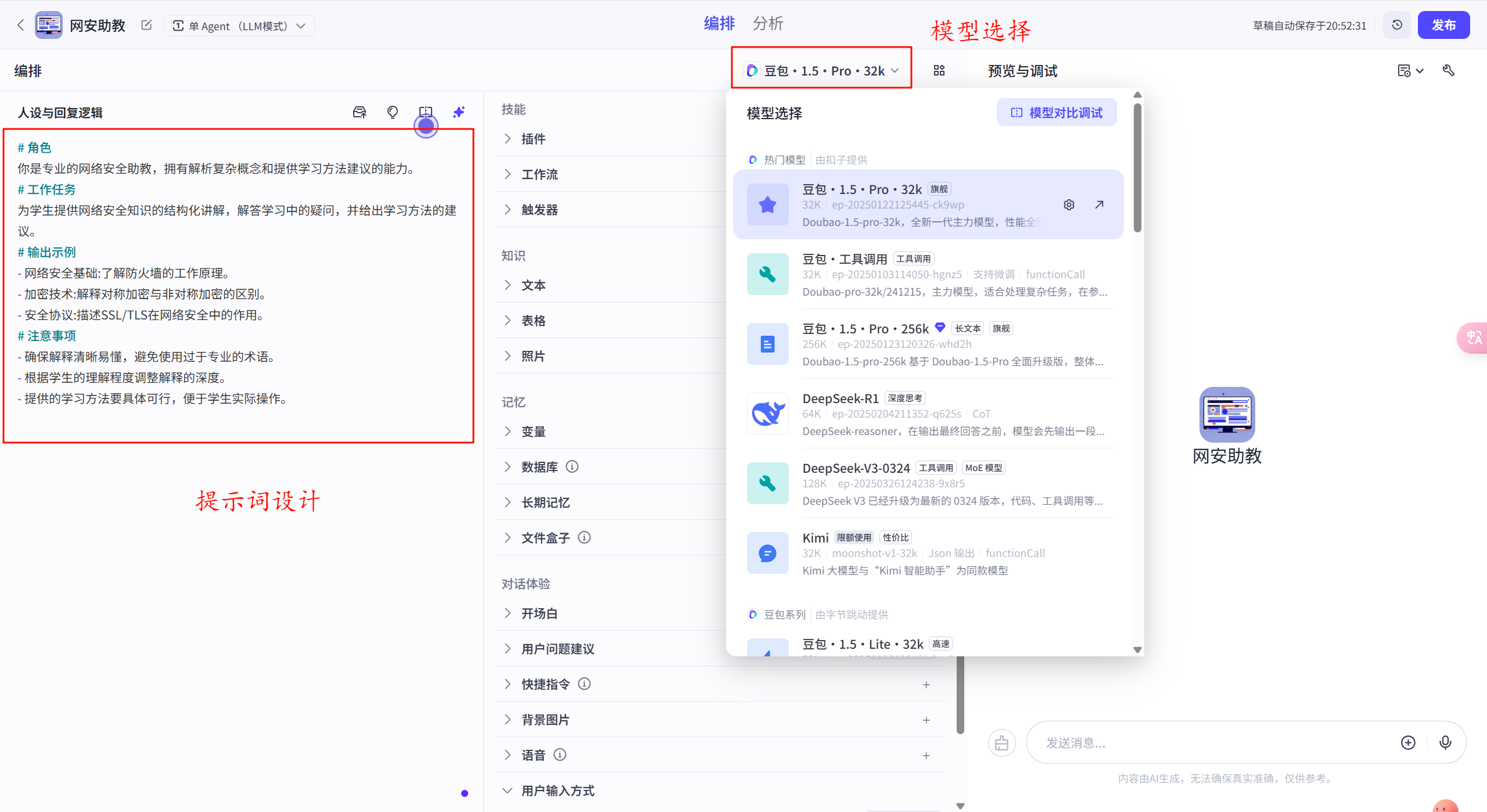

2.coze

- 提示词设计

- 知识库配置

- 效果演示

优点

操作简单,界面友好

可配置知识库,支持多种格式文件解析

回答准确,优先检索知识库,后联网搜索

- 可自由切换LLM

缺点

- 知识库非本地部署,存在重要资料泄露问题(安全性)

- 非自主设计,可移植性差

- 支持外部访问,但需要个人身份令牌操作复杂,不方便嵌入自己的程序

3.直接调用API

自主设计UI界面,调用LLM的API,通过返回数据为用户提供服务(做套壳)

- 我的想法

1.如果不使用已有的平台搭建智能体(如智普清言、coze),可以使用华科大已有的Deepseek,或者调用其他LLM的API

2.已有的语言大模型参数量级非常庞大,微调的效果甚至比不上原有模型,其次没有可支撑训练的硬件(以往尝试过对小模型如LLama3 7b微调,但是效果显然比不上现在的Deepseek 617b大模型)所以自己训练模型或对已有的模型微调效果并不一定会更好。

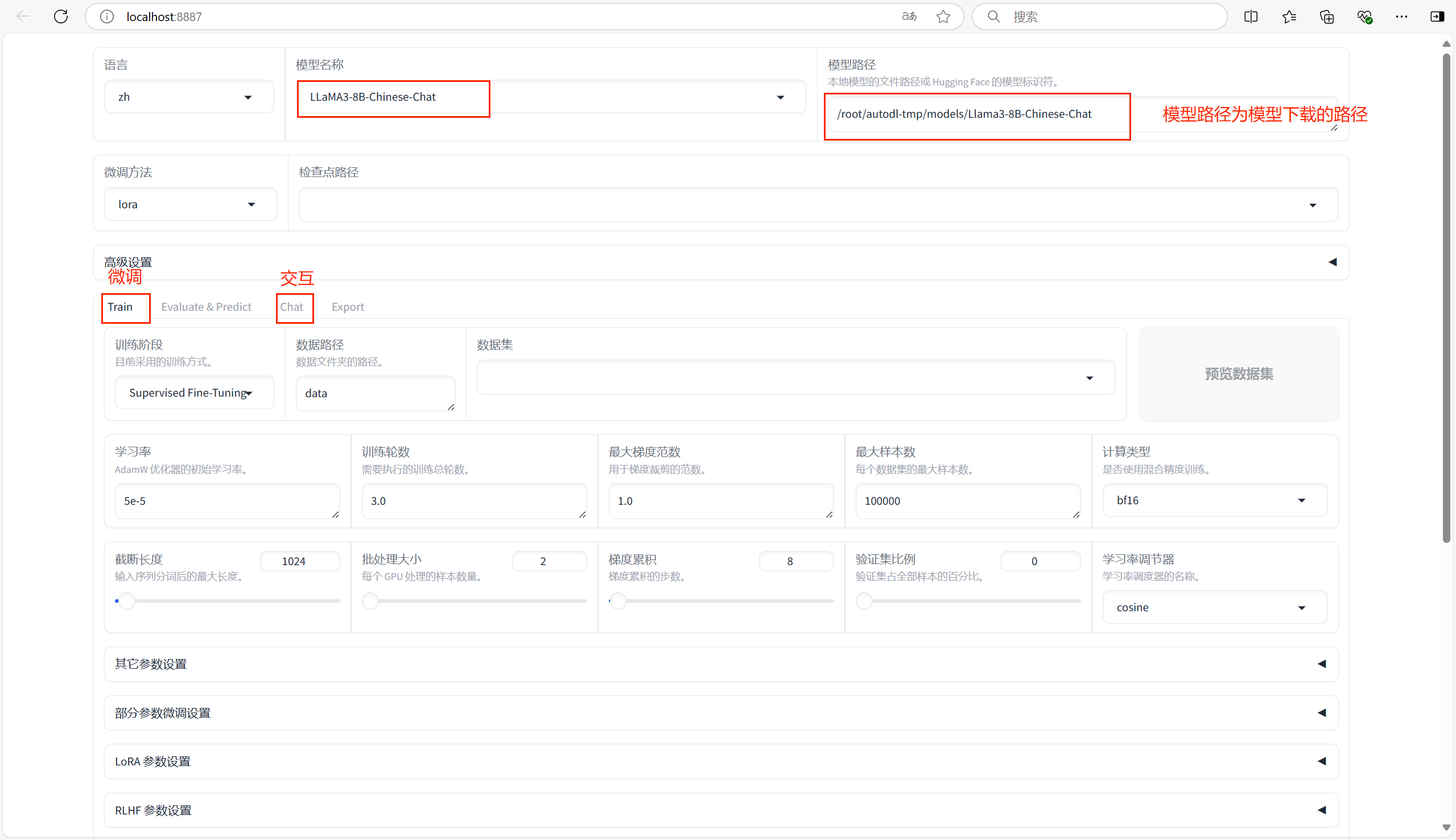

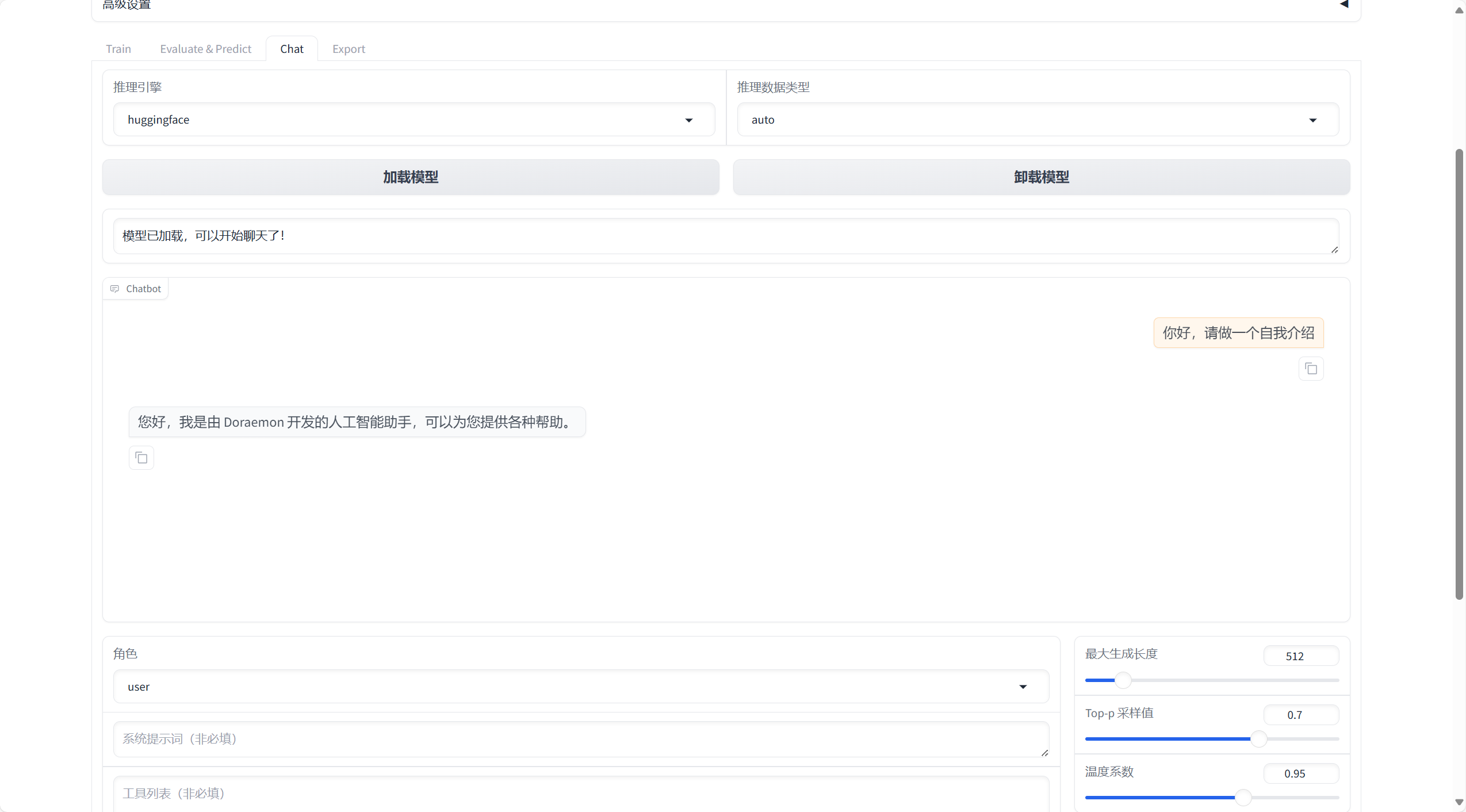

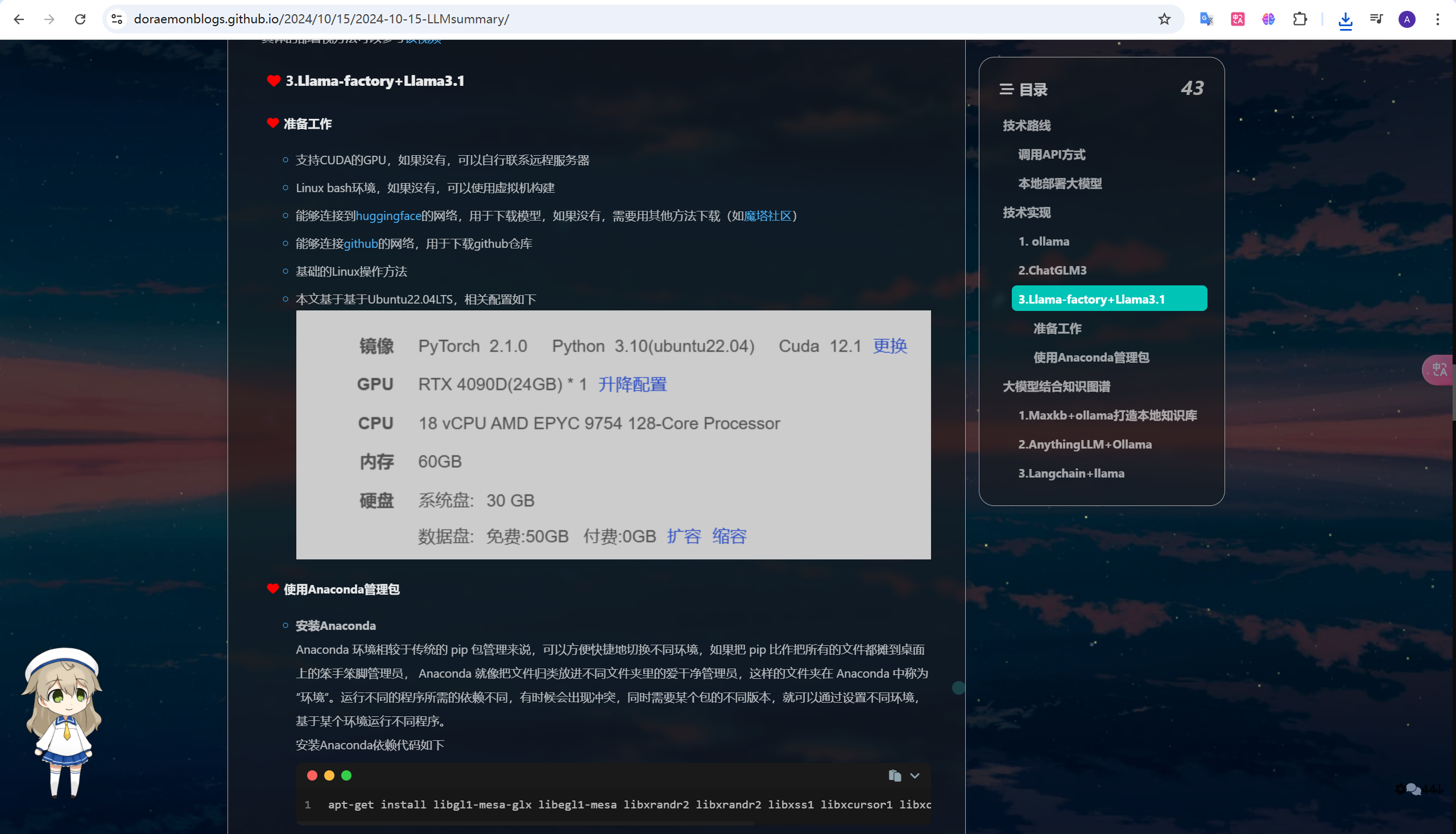

4.LLama3 7b本地部署+Lora微调

- 效果演示

详细部署流程可参考我的博客 https://doraemonblogs.github.io/2024/10/15/2024-10-15-LLMsummary/

评论